Tesla столкнулась с манекеном: тест автономного вождения провален

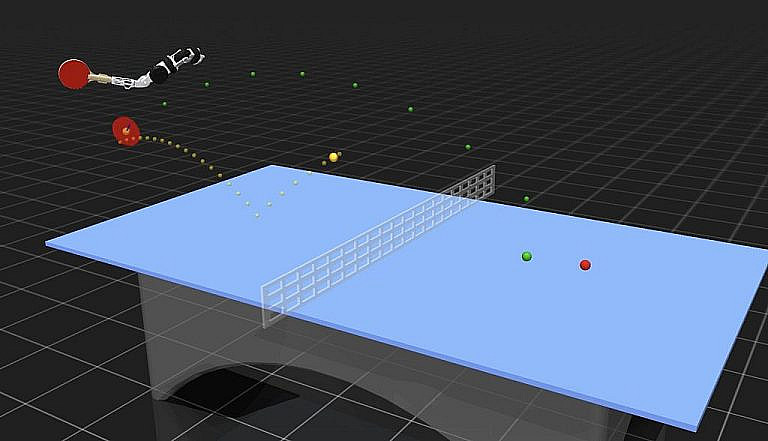

Технология автономного вождения Tesla снова под прицелом. Последний тест системы Full Self-Driving (FSD) показал тревожные результаты: автомобиль протаранил манекен размером с ребенка, несмотря на его обнаружение. Видео, опубликованное проектом Dawn Project, демонстрирует, как Model Y с версией ПО 13.2.9 игнорирует развернутый знак остановки школьного автобуса и мигающие красные огни.

Система корректно идентифицировала манекен как пешехода, но не предприняла действий для предотвращения столкновения. Основатель Dawn Project Дэн О’Дауд уже два года предупреждает о подобных рисках — в 2023 году его предостережения подтвердились инцидентом в Северной Каролине, где Tesla сбила подростка.

Ограниченный запуск роботакси

Илон Маск тем временем анонсировал тестирование роботакси в Остине, пообещав строгий контроль и географические ограничения. Это выглядит скромнее его же прогноза 2019 года о миллионе беспилотных такси к 2020-му. Критики отмечают разрыв между обещаниями и реальными возможностями FSD.

Безопасность под вопросом

Компания не стала подавать в суд на авторов тестов, что косвенно может свидетельствовать об осознании проблем. Главный вопрос: готова ли технология к массовому внедрению, если даже в контролируемых условиях она демонстрирует критические сбои?